"El objetivo es estar lo más informados posible sobre lo que está pasando ahora mismo, sin sentirse impotentes o excluidos" Paul Tighe: 'Antiqua et nova' ofrece orientaciones sobre el desarrollo ético de la IA

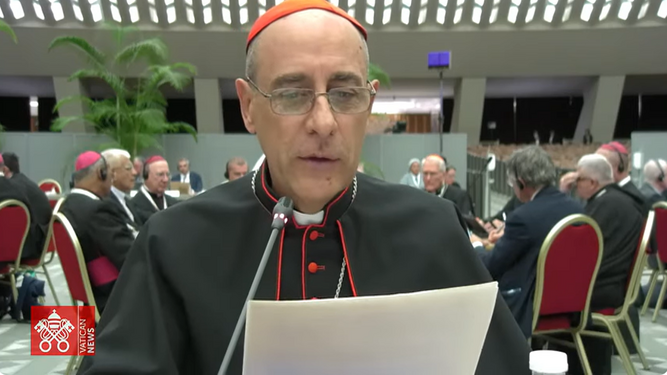

El secretario del Dicasterio para la Cultura y la Educación habla a los medios vaticanos sobre el documento vaticano sobre la inteligencia artificial, destacando el gran potencial de la IA y al mismo tiempo la necesidad de que la humanidad guíe su desarrollo a través de la responsabilidad colectiva por el bien de todos

"Queremos abrazar algo que tiene un enorme potencial para los seres humanos: queremos ver este potencial, pero al mismo tiempo prestar atención a los posibles efectos contraproducentes"

"Creo que las cuestiones que emergen con fuerza en este documento se refieren al riesgo de que la desigualdad aumente con la IA"

"Creo que las cuestiones que emergen con fuerza en este documento se refieren al riesgo de que la desigualdad aumente con la IA"

| Devin Watkins

(Vatican News).- El Dicasterio para la Doctrina de la Fe y el Dicasterio para la Cultura y la Educación publicaron el martes 28 de enero un documento titulado «Antiqua et nova: Nota sobre la relación entre inteligencia artificial e inteligencia humana». En declaraciones a los medios vaticanos, monseñor Paul Tighe, secretario del Dicasterio para la Cultura y la Educación, explicó que con esta Nota quieren contribuir al debate sobre esta cuestión ofreciendo orientaciones éticas y elementos de reflexión.

«Hay una comprensión más amplia de la inteligencia», dijo, “que tiene que ver con nuestra capacidad humana de encontrar propósito y sentido a nuestras vidas, y ésta es una forma de inteligencia que las máquinas simplemente no son capaces de sustituir”.

Monseñor Tighe, ¿qué hay de «nuevo» en este documento y qué espera comunicar al mundo, especialmente a la Iglesia?

El documento recoge muchas reflexiones que se han ido desarrollando orgánicamente en los últimos años. Lo que pretende es ofrecer a la gente algunas perspectivas desde las que puedan empezar a pensar de forma crítica sobre la IA y sus beneficios potenciales para la sociedad, y luego alertar a la gente sobre a qué debemos prestar atención para asegurarnos de que no hemos creado inadvertidamente algo que podría ser perjudicial para la humanidad y la sociedad. Yo diría que aquí hay un cierto elemento de precaución. Muchos de nosotros, con la llegada de las redes sociales, nos hemos apresurado a abrazar su extraordinario potencial. Y tal vez no vimos en cambio cuáles podrían ser las desventajas en términos de polarización, noticias falsas y otras cuestiones.

Queremos abrazar algo que tiene un enorme potencial para los seres humanos: queremos ver este potencial, pero al mismo tiempo prestar atención a los posibles efectos contraproducentes. Y creo que eso es lo que intentamos hacer aquí. Un día leemos en los titulares que la IA será la salvación de todos nosotros y al día siguiente que causará la aniquilación y el fin del mundo. Intentamos ofrecer a la gente un enfoque más equilibrado. El documento se detiene en una serie de puntos. Hay algunas cuestiones principales relacionadas con el futuro del empleo, la guerra, las falsificaciones y las desigualdades. Hay cuestiones éticas y sociales en las que queremos detenernos. Sin embargo, al abordar estas cuestiones, intentamos al mismo tiempo cuestionar y centrarnos en una cuestión que es más subyacente, a saber, la cuestión antropológica de lo que significa ser humano. ¿Qué es lo que da a la vida humana un valor, un propósito, un sentido?

Reconocemos que los sistemas de IA pueden reforzar y mejorar ciertos aspectos de nuestra humanidad, como nuestra capacidad de razonar, de procesar, de discernir, de descubrir, de ver caminos, de generar innovaciones. Lo que queremos afirmar es que hay una comprensión más amplia de la inteligencia que tiene que ver con nuestra capacidad humana de encontrar propósito y sentido a la vida. Parte de la pregunta que debemos hacernos es: ¿qué es lo bueno para la humanidad? ¿Qué es lo que fomenta el bienestar de los seres humanos? Y ésta es una forma de inteligencia que las máquinas sencillamente no pueden sustituir.

En la tradición católica, la forma en que entendemos la inteligencia es algo más que razonar, calcular y procesar, sino que también incluye nuestra capacidad de buscar un propósito, un sentido y una dirección en nuestras vidas. Creo que lo que siempre nos preocupa es la búsqueda de la verdad última, qué es lo que da forma, propósito y sentido a la vida. Así que podemos utilizar la IA para que nos ayude en algunos aspectos pero, en última instancia, nuestra dimensión intelectual va más allá de algo que pueda hacer simplemente una máquina.

El desarrollo de la IA avanza a gran velocidad. ¿Por qué el Dicasterio para la Doctrina de la Fe y el Dicasterio para la Cultura y la Educación han decidido publicar la Nota en este momento?

Ciertamente, desde nuestro punto de vista, en lo que concierne al mundo de la educación, todos los educadores se preguntan cuál es el potencial de la IA en términos de apoyo a la educación y sobre los riesgos de una cierta despersonalización, a causa de la IA, de la naturaleza misma de la educación. Al mismo tiempo, estamos respondiendo a las preguntas que se plantean durante las visitas ad limina, porque los obispos necesitan algunas orientaciones a este respecto. El documento nace de ahí y reúne muchas otras iniciativas. También ofrece una unidad de visión, que pretende unir las cuestiones éticas y vincularlas a la visión antropológica más fundamental de lo que nos hace humanos.

La UNESCO dijo que -y esto es lo que más me llamó la atención- está dando lugar a lo que ellos llaman una «disruptio antropologica». A Silicon Valley le encanta el lenguaje de la disrupción, de romper para reinventar. Pero aquí, cuando hablamos de la naturaleza de lo que es un ser humano, es muy importante que reflexionemos críticamente sobre ello sin pasar por alto la cuestión del sentido último de la vida. Y aquí creo que las cuestiones que emergen con fuerza en este documento se refieren al riesgo de que la desigualdad aumente con la IA. Esto puede verse, en general, por lo que ha ocurrido con la digitalización, que ha llevado al ascenso de un número muy pequeño de personas extraordinariamente ricas con enormes cantidades de poder, y que no son necesariamente responsables ante otras instituciones. Entonces, ¿cómo hacer para que esto no contribuya a fracturar la unidad de la familia humana, que también debe estar unida en su acceso al poder y a la información?

Un ámbito en el que la IA tiene un enorme potencial es el de la asistencia sanitaria. Pero sabemos que la asistencia sanitaria ya tiende a distribuirse de forma poco equitativa. ¿Aumentará la IA las desigualdades en este ámbito? Gran parte de nuestras reflexiones abordan estas cuestiones.

Cuando uno piensa en la relación de la humanidad con la IA, le vienen a la mente los cuentos de ciencia ficción de Isaac Asimov, «El ciclo del robot». ¿Tiene esta Nota una visión más favorable o más cauta de la IA?

Espero que adopte un punto de vista intermedio, es decir, que no abrace ninguna de las dos visiones apocalípticas. Tampoco trata de imaginar que la IA por sí sola será la base para resolver todos los problemas de la humanidad. Trata de ver el potencial que representa la IA. Es una reflexión sobre la capacidad de la humanidad para aprender, para innovar, para desarrollarse, que es una capacidad dada por Dios. Queremos celebrarlo. Al mismo tiempo, sabemos de muchas innovaciones extraordinarias que tuvieron un enorme potencial en el pasado, pero que luego resultaron problemáticas por diversas razones. Problemáticas porque quizá había fallos inherentes en los propios sistemas. Problemáticas porque la gente podía utilizar la misma tecnología para cosas muy buenas, pero al mismo tiempo conseguir cosas muy malas. A veces problemáticos porque los sistemas -y aquí estamos pensando en la IA- se desarrollaron en un contexto comercial y político concreto y podrían estar ya marcados por los valores de esos entornos.

Queremos desarrollar el pensamiento crítico y asegurarnos de que la IA sea una herramienta que pueda ser utilizada por la humanidad de forma que aproveche su potencial beneficioso para todos los seres humanos. La humanidad debe controlar los procesos y velar porque exista un sentido de la responsabilidad. Y aquí es donde entran en juego las historias del «Ciclo de los robots» de Asimov. ¿Dónde reside la responsabilidad?

Las máquinas de IA harán cosas extraordinarias. Habrá momentos en los que no entenderemos cómo las hacen. Están desarrollando la capacidad de reprogramarse y avanzar por sí mismas. Así que lo que tenemos que hacer es intentar comprender: ¿dónde reside la responsabilidad? En la industria, muchos hablan ahora de que la IA es «ética por diseño». Así que debemos pensar desde el principio: ¿cuáles son los problemas? ¿Cuáles son las dificultades? ¿Cómo podemos planificar las cosas para evitar los problemas? Todo esto significa: ¿cómo la hacemos segura, para que funcione bien, para que no funcione mal? ¿Cómo garantizar que no sea fácilmente explotada por personas que podrían utilizarla con fines negativos? ¿Cómo garantizar que la IA sea algo que refleje lo mejor de nosotros como seres humanos?

Por esta razón, siempre intentamos responsabilizar a quienes diseñan, planifican y desarrollan, pero también a quienes utilizan la IA.

Si pudiera destacar un aspecto de este documento, ¿cuál sería?

Lo que me gustaría decir a la gente que va a leer este texto es que, sean católicos o no, el objetivo es estar lo más informados posible sobre lo que está pasando ahora mismo, sin sentirse impotentes o excluidos. Lo digo como alguien que ya ha recorrido un largo camino en la vida, y se lo digo a mi generación, para que no sienta que estamos retrocediendo. Una cosa que le diría a la gente es que empiecen a usar las tecnologías, que las exploren, que vean lo increíbles que son, pero que al mismo tiempo empiecen a desarrollar un punto de vista crítico hacia ellas, que aprendan a ser capaces de evaluarlas y reflexionar sobre ellas.

Un aspecto que yo extraería del documento es la importancia de la responsabilidad. Cada uno debe reflexionar sobre su grado de responsabilidad -y esto también concierne y se extiende al usuario- y preguntarse: ¿voy a empezar a compartir contenidos que sé que son dudosos o que imagino que pueden incitar al odio? Y asumir así la responsabilidad de cómo utilizo la IA.

Etiquetas